張家輝,復旦大學大數據學院博士三年級學生,研究方向為具身智能、視覺 - 語言 - 動作模型預訓練與強化學習后訓練,4D-VLA (NeurIPS 25) 第一作者。黃澤,復旦大學大數據學院博士三年級學生,主要從事機器人世界模型與三維重建、生成等方向研究。兩人共同擔任本文第一作者。

張力,復旦大學大數據學院教授,上海創智學院全時導師,擔任本論文的通訊作者。主頁:https://lzrobots.github.io

Vision–Language–Action(VLA)策略正逐漸成為機器人邁向通用操作智能的重要技術路徑:這類策略能夠在統一模型內同時處理視覺感知、語言指令并生成連續控制信號。

然而,當前大多數 VLA 仍主要依賴模仿學習,實質上是按示范軌跡復刻,在分布發生偏移、任務形式變化或操作時域拉長時,極易出現誤差累積并導致任務失敗。強化學習(RL)從回報信號出發直接優化任務成功率,按理應當能夠緩解這一目標錯配問題,但在真實機器人上開展在線 RL 成本高昂,并行執行受限,還伴隨大量重置與標注開銷;以 π*0.6 為代表的多輪離線 RL 范式在每一輪中仍高度依賴真實系統部署和人工干預,訓練成本與迭代效率都存在明顯瓶頸(需要一直有人類介入,一旦出現錯誤軌跡就人類接管操作,記錄相應的數據);另一方面,基于傳統物理引擎(MuJoCo、Isaac sim)的強化學習又難以同時兼顧逼真度、場景多樣性與工程可用性。

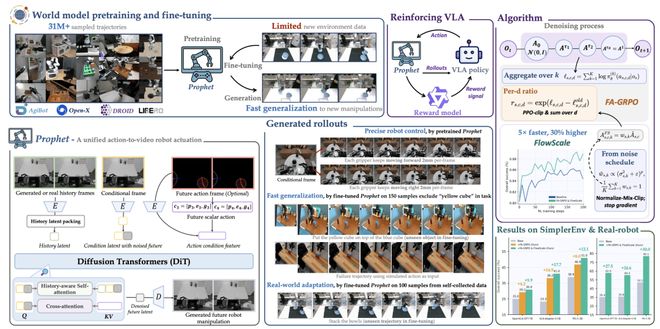

針對上述問題,研究團隊提出ProphRL 框架采用大規模預訓練的世界模型 Prophet 作為「面向真實環境」的視頻級模擬器,并配合專為流式動作頭設計的在線 RL 算法 Flow-Action-GRPO 與 FlowScale,在虛擬但物理一致的環境中直接對 VLA 策略進行強化學習優化,再將優化后的策略部署到真實機器人上。如此,策略改進的主要探索過程可以在世界模型中完成,在兼顧物理可信度的同時顯著降低真實交互成本,為大模型 VLA 的實際落地提供了更可行的技術路徑。如圖所示:

實驗結果顯示,ProphRL在多個公開基準上為各類 VLA 模型(VLA-adapter-0.5B, Pi0.5-3B, OpenVLA-OFT-7B)帶來 5–17% 的成功率提升,在真實機器人實驗中進一步取得 24–30% 的大幅度成功率提升