如今的 AI 領域,大多數大語言模型在很大程度上仍以「黑箱」方式工作,即使是專業的研究者也難以完全理解它們的內部計算過程。因此,提升模型的透明度有助于分析和解釋大語言模型產生幻覺、行為不穩定或在關鍵場景做出不可靠判斷的潛在原因。

就在今天,OpenAI 發布了一項新研究,使用新方法來訓練內部機制更易于解釋的小型稀疏模型,其神經元之間的連接更少、更簡單,從而觀察它們的計算過程是否更容易被人理解。

與普通模型不同,OpenAI 發現可以從該稀疏模型中提取出簡單、易于理解的部件來執行特定任務,例如在代碼中正確結束字符串或跟蹤變量類型。

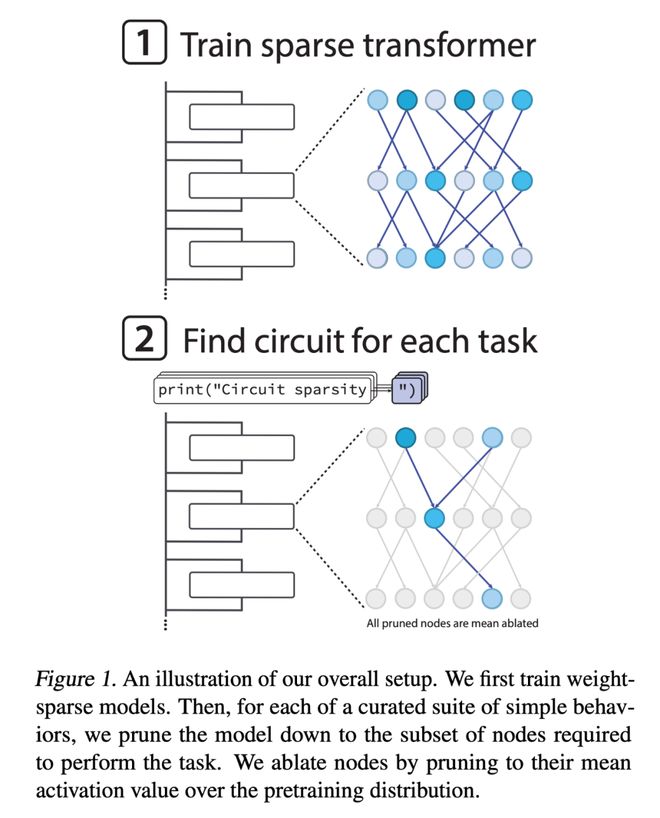

下圖為整體方法概覽,首先訓練權重稀疏的模型,然后針對精心挑選的一系列簡單行為,將模型剪枝到僅保留完成該任務所需的節點子集。

論文一作 Leo Gao 表示,「通過隔離稀疏模型內部負責各種簡單行為的微小電路,以前所未有的方式理解語言模型。」